machine learning

好久没碰又忘了…😣 复习复习!!!

logistic 逻辑回归模型

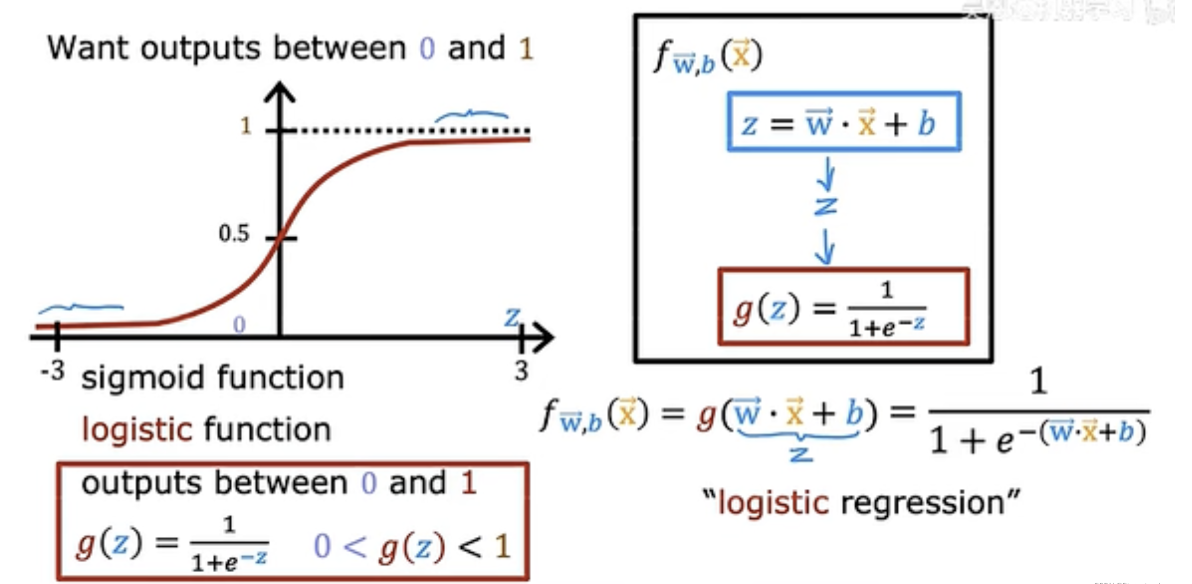

1. sigmoid function (logistic function)

输出$f_{w,b}(x) = P(y=1|x;w,b)$:y 等于 1 的概率

[!NOTE]

如何理解?

When is $f_{w,b}(x) ≥ 0.5$

g(z) ≥ 0.5

z ≥ 0

w*x + b ≥ 0

决策边界: z = w*x+b = 0

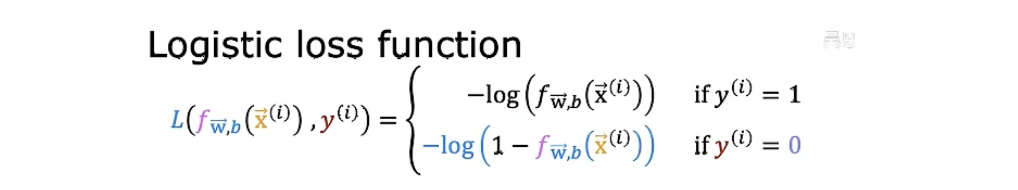

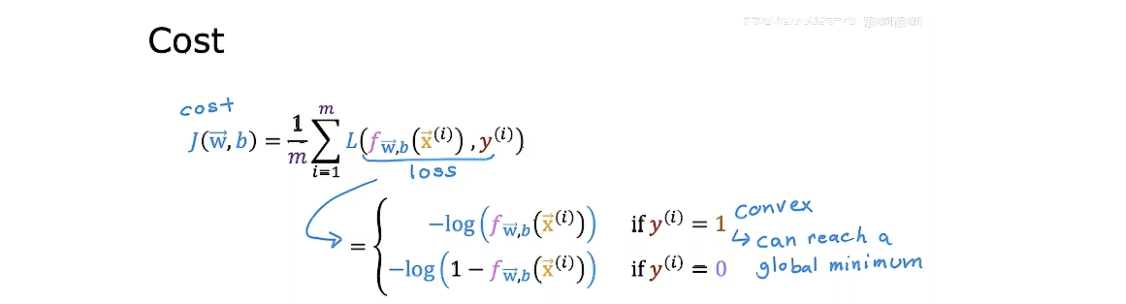

2 逻辑回归的损失函数

平方损失函数会造成函数不凸,下降无法收敛到最小值,不适用。

损失函数

代价函数

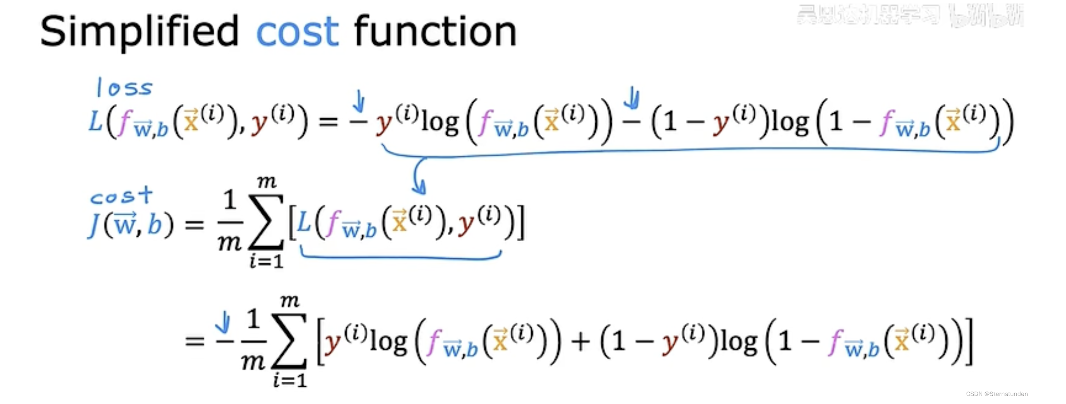

简化版

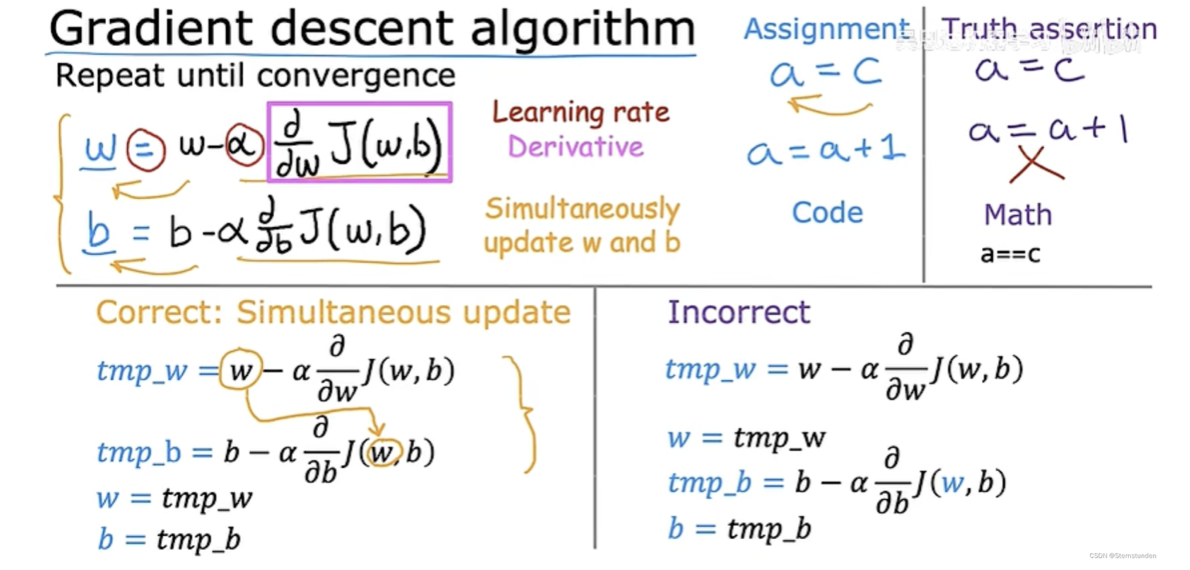

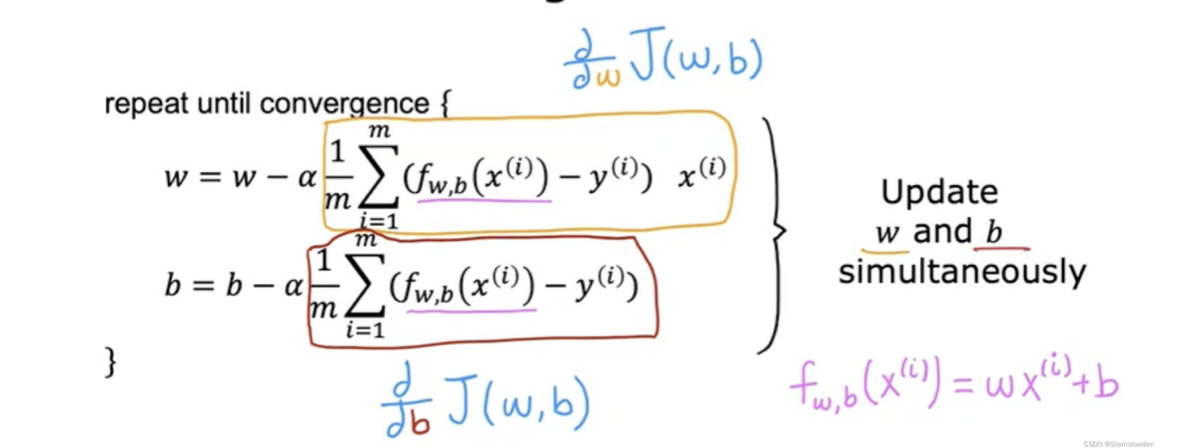

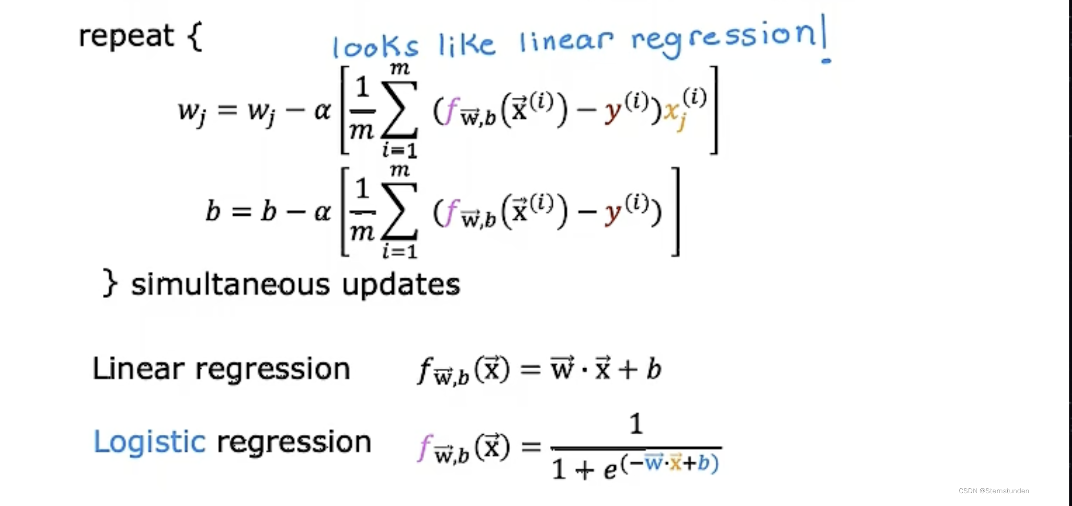

梯度下降

目标:找到合适的 w, b

改进:放缩(除以最大值 / 均值归一化 / z分数归一化)

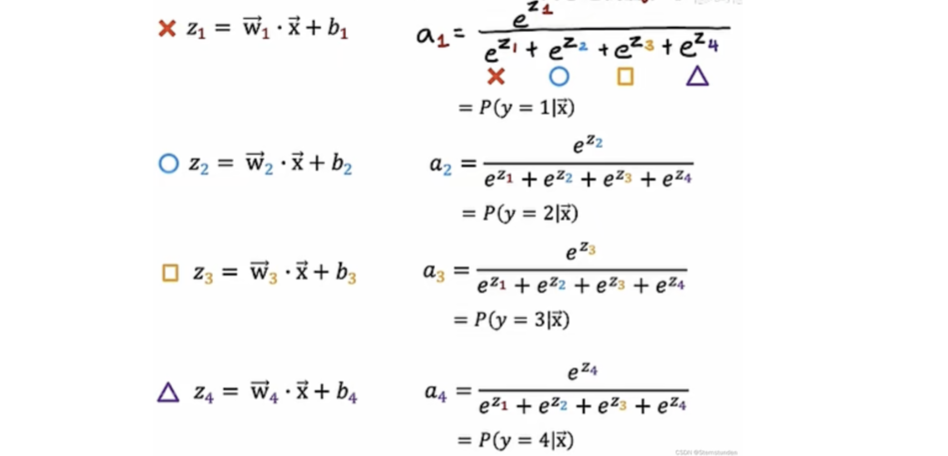

softmax 多分类

以四个可能的输出值为例:

$a_{1} + a_{2} + a_{3} + a_{4} = 1$

Softmax regression:N 个可能的输出值

$z_{j} = w_{j} x + b_{j} j = 1, …, N$ $a_{j} = \frac{e^{Z_{j}}}{\sum_{k=1}^Ne^{Z_{k}}}$ $a_{1} + a_{2} + … + a_{N} = 1$

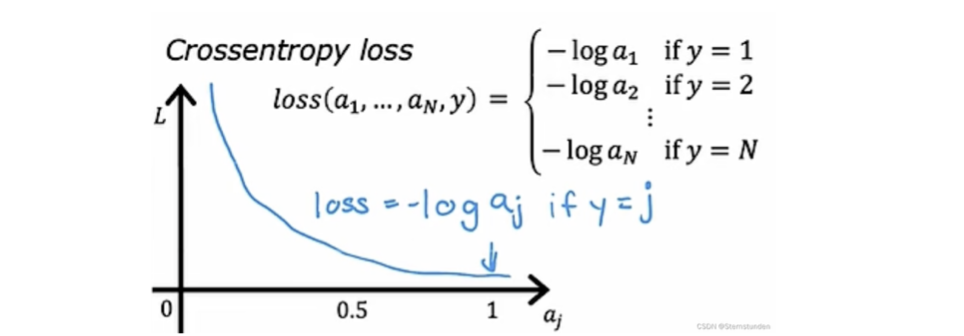

损失函数

线性回归

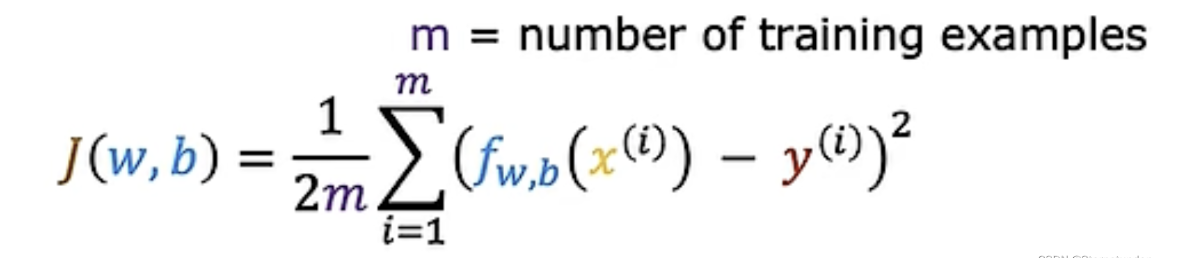

损失函数:平方误差

梯度函数

参数初始值并不重要,通常将它们设置为 0 :不同方向下坡、找局部最小值